AI读图会意首超人类阿里达摩院刷新全球机器视觉问题纪录

AI 科技评论报道

编辑 陈大鑫

8月12日,AI 科技评论注意到,国际权威机器视觉问答榜单 VQA Leaderboard出现关键突破:阿里巴巴达摩院以81.26%的准确率创造了新纪录,让AI在“读图会意”上首次超越人类基准。继2015年、2018年AI分别在视觉识别及文本理解领域超越人类分数后,人工智能在多模态技术领域也迎来一大进展。

图注:达摩院AliceMind在VQA Leaderboard上创造首次超越人类的纪录

比较难得的是,3年前,让中国AI在文本理解领域历史性超越人类的,同样是达摩院AI研究团队。

VQA是什么?

近10年来,AI技术保持高速发展,AI模型已在多个任务和技能上达到超越人类的水平,比如在游戏领域,强化学习智能体 AlphaGo 2016 年击败了世界顶尖棋手李世石;在视觉理解领域,以 CNN 为代表的卷积类模型 2015 年在 ImageNet视觉分类任务上超越了人类成绩;在文本理解领域,2018年微软与阿里几乎同时在斯坦福SQuAD挑战赛上让 AI 阅读理解超越了人类基准。

然而,在视觉问答VQA(Visual Question Answering)这一涉及视觉-文本多模态理解的高阶认知任务上,AI 过去始终未取得超越人类水平的突破。

“诗是无形画,画是有形诗。”宋代诗人张舜民曾如此描绘语言与视觉的相通之处。随着深度学习、视觉理解、文本理解等领域高速发展,自然语言技术与计算机视觉交融逐渐成为多模态领域重要的前沿研究方向。其中,VQA是多模态领域挑战极高的核心任务,解决VQA挑战,对研发通用人工智能具有重要意义。

为鼓励攻克这一难题,全球计算机视觉顶会CVPR从2015年起连续6年举办VQA挑战赛,吸引了包括微软、Facebook、斯坦福大学、阿里巴巴、百度等众多顶尖机构参与,形成了国际上规模最大、认可度最高的VQA数据集,其包含超20万张真实照片、110万道考题。

VQA 是AI领域难度最高的挑战之一。在测试中,AI需根据给定图片及自然语言问题生成正确的自然语言回答。这意味着单个AI模型需融合复杂的计算机视觉及自然语言技术:首先对所有图像信息进行扫描,再结合对文本问题的理解,利用多模态技术学习图文的关联性、精准定位相关图像信息,最后根据常识及推理回答问题。

今年6月,阿里达摩院在 VQA 2021 Challenge 的55支提交队伍中夺冠,成绩领先第二名约1个百分点、去年冠军3.4个百分点。两个月后,达摩院再次以81.26%的准确率创造VQA Leaderboard全球纪录,首次超越人类基准线80.83%。

这一结果意味着,AI 在封闭数据集内的 VQA 表现已媲美人类。

面对更开放的现实世界,AI一定会遇到新的挑战,需要喂更多的数据、进一步提升模型。但和 CV 等领域的发展一样,这一结果依然具有标志性意义,相信VQA技术在现实中的表现提升只是时间问题。

VQA分数超人类如何诞生?

VQA挑战的核心难点在于,需在单模态精准理解的基础上,整合多模态的信息进行联合推理认知,最终实现跨模态理解,即在统一模型里做不同模态的语义映射和对齐。

据了解,为了解决VQA挑战,达摩院语言技术实验室及视觉实验室对AI视觉-文本推理体系进行了系统性的设计,融合了大量算法创新,包括:

-

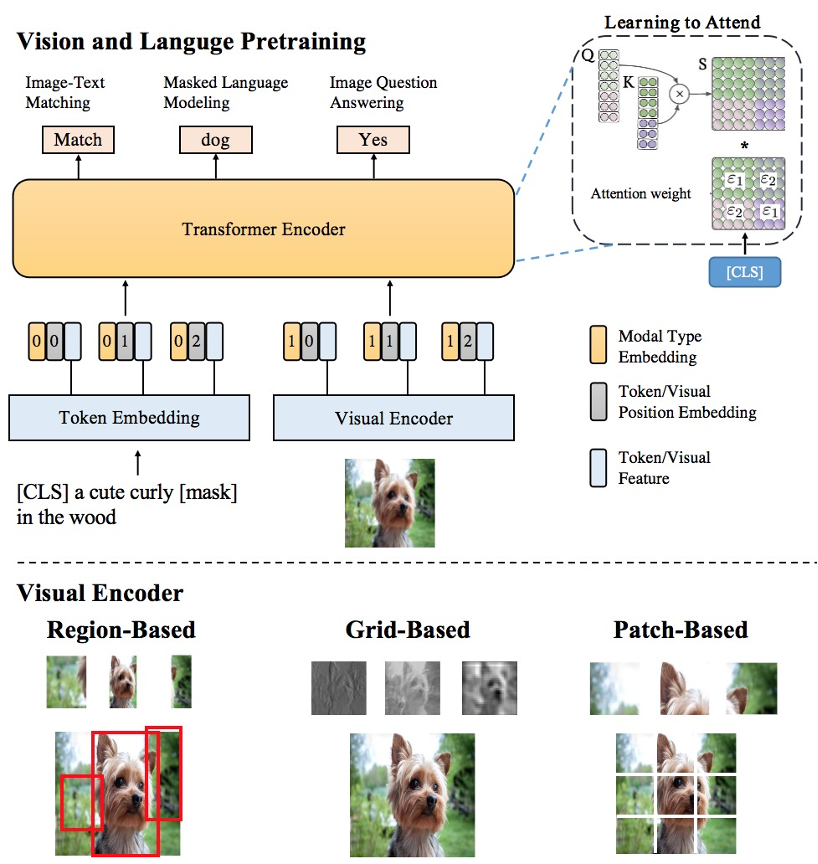

多样性的视觉特征表示,从各方面刻画图片的局部和全局语义信息,同时使用Region,Grid,Patch等视觉特征表示,以更精准地进行单模态理解; -

基于海量图文数据和多粒度视觉特征的多模态预训练,用于更好地进行多模态信息融合和语义映射,创新性地提出了SemVLP,Grid-VLP,E2E-VLP和Fusion-VLP等预训练模型; -

研发自适应的跨模态语义融合和对齐技术,创新性地在多模态预训练模型中加入Learning to Attend机制来进行跨模态信息地高效深度融合;

4.采用Mixture of Experts (MOE)技术进行知识驱动的多技能AI集成。

其中自研的多模态预训练模型E2E-VLP,StructuralLM已被国际会议ACL2021接受。

模型大图如下:

VQA 考高分有什么用?

VQA考卷有多难?

论文链接:

1. E2E-VLP: End-to-End Vision-Language Pre-training Enhanced by Visual Learning, ACL2021

2. A Structural Pre-trained Model for Table and Form Understanding, ACL 2021

3. SemVLP: Vision-Language Pre-training by Aligning Semantics at Multiple Levels

雷峰约稿件,未经授权禁止转载。详情见转载须知。